Google GLaM

Общая языковая модель

О Google GLaM

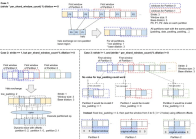

Google GLaM - это тип модели, который использует стратегию микстуры экспертов (MoE). Это означает, что у него есть отдельные подмодели (эксперты), каждая из которых настроена на различные входные параметры. Эксперты управляются сетью роутинга, которая определяет, какие из них активировать в зависимости от обрабатываемых данных. Для каждого анализируемого куска данных (обычно это слово или часть слова) сеть роутинга выбирает двух наиболее подходящих экспертов, чтобы работать с ним. В полной версии GLaM в общей сложности имеется 1,2 Т параметров, распределенных по 64 экспертам на слой MoE и 32 слоям MoE всего. Однако при выводе только часть этих параметров, примерно 97 млрд (8% от 1,2 Т), активируется для каждого предсказания токена.

Источник: https://ai.googleblog.com/2021/12/more-efficient-in-context-learning-with.html

Скриншоты Google GLaM

Читать на английском

Все о GPT-3

Все о GPT-3